2.1 ПЕРЦЕПТРОН-общие положения

Перце́птрон - модель зрительного восприятия и соответствующие ей математическая и физические (электронные) модели.

Персептрон состоит из одного слоя искусственных нейронов, соединенных с помощью весовых коэффициентов с множеством входов (см. рис.2.4), хотя описываются и более сложные системы.

Рис. 2.4. Структура перцептрона.

Привлекает внимание схожесть рисунка 2.4 и схемы элементарного перцептрона на рис.2.3 . Схожесть проявляется при масштабировании единственного выхода на множественные и прорисовке в единых обозначениях.

Розенблатт называл такую нейронную сеть трехслойной, однако, по современной терминологии, представленная сеть обычно называется однослойной, так как она имеет только один слой нейропроцессорных элементов. Так утверждает, например, Википедия — свободная энциклопедия. С точки зрения теории графов, перцептрон действительно является трёхслойной сетью, так как содержит три слоя элементов, последовательно выполняющих фиксированные операции.

Перцептрон можно представить следующим образом:

Рис. 2.5. Структурная схема перцептрона с тремя выходами

По рисунку видно, что система использует лишь одну матрицу весов [vij] от узла i к узлу j на входах реагирующего слоя. Ассоциативные элементы лишь производят суммирование (с учётом знака) рецепторных элементов. Сенсорные элементы лишь преобразуют энергию световых колебаний в электрическую.

Элемент Ʃ умножает каждый вход x на вес w и суммирует взвешенные входы. Если полученная сумма больше заданного порогового значения, выход равен единице, в противном случае — нулю.

В исходном перцептроне, S-элементы выдают логические сигналы «1» или «0», выраженные определённым уровнем напряжения на выходе, в зависимости от того, освещён или нет соответствующий участок изображения. Следовательно, сенсор должен содержать некоторый пороговый элемент, переводящий аналоговый выходной сигнал датчика в логический.

Это вполне понятно при чтении печатных текстов, но плохо расширяется на распознавание лиц в условиях изменчиво освещенности. Значит и структура перцептрона для этих целей должна быть модернизирована.

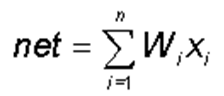

Математически, устройство описывается следующей функцией (1):

1

1

,где xj – освещённость j-го участка изображения. Подсчёт взвешенной суммы входных сигналов является основной функцией искусственного нейроноподобного элемента.

Сигнал net обрабатывается пороговым устройством и получается сигнал out:

out = f(net)

Наличие порогового элемента позволяет не только распознавать конкретные изображения, которым обучен перцептрон, но и создавать более сложные электронные сети. Это, вероятно, и позволяет называть перцептрон «искусственным нейроном».

Перцептрон состоит из трёх типов элементов, а именно: поступающие от сенсоров сигналы передаются ассоциативным элементам, а затем реагирующим элементам. Таким образом, перцептроны позволяют создать набор «ассоциаций» между входными стимулами и необходимой реакцией на выходе. В биологическом плане это соответствует преобразованию, например, зрительной информации в физиологический ответ от двигательных нейронов. Согласно современной терминологии, перцептроны могут быть классифицированы как искусственные нейронные сети:

- с одним скрытым слоем;

- с пороговой передаточной функцией;

- с прямым распространением сигнала.

По Розенблату, перцептроном называется нейронная сеть, состоящая из чувствительных, ассоциативных и реагирующих элементов. Сенсорный элемент способен выдавать сигналы 0 или 1, в зависимости от освещённости его зошы ответственности. Далее, сигналы поступают в ассоциативный слой, составленный из нейронов МакКалока-Питса с бинарной пороговой функцией активации. Реагирующий элемент – обычный нейрон с биполярно-пороговой функцией активации. Реагирующие элементы с фиксированными весами формируют сигнал реакции перцептрона на входной стимул.

Так же сеть удовлетворяет следующим условиям:

- В сети имеются только последовательные связи от чувствительных к ассоциирующим элементам и от ассоциирующих элементов к реагирующему элементу.

- Веса связей между чувствительными и ассоциирующими элементами являются фиксированными.

- Время передачи сигналов каждой связью равно нулю (либо фиксированной постоянной величине).

- Выходные сигналы всех нейронов сети формируются в виде:

net=Ʃjn=1wjxj

В Трёхслойном перцептроне с единственным скрытым слоем и последовательными связями:

- Сенсорный слой S: c*Wi(t) → S → s*i(t). В простом S элементе s*i= +1, если c*Wi(t) > θi, иначе s*i=0

- Ассоциативный слой A: s*i(t) → cij → A → a*j(t), где cij – сеть связей от si к элементу aj

Простой A: a*j =+1, если Ʃ c*ij > θj, иначе a*j = 0

- Регулирующий слой R: a*j(t) → R → r*i(t)

Простой R: r*i =+1, если Ʃ a > 0, r*i =-1, если Ʃ a<0, иначе r*i = 0, или не определено

В элементарном перцептроне коэффициенты связей S-A фиксированные, а A-R настраиваемые. Обозначим вес связи ai-R в элементарном перцептроне vi.

Перцептрон Розенблатта обучается алгоритмом коррекции ошибки. Этим алгоритмом обучаются только веса между скрытым и выходным слоем. Веса между входным и скрытым слоем не обучается, а назначаются случайно. Возбуждающие и тормозящие связи создаются в перцептроне случайным образом (моделируя природу). Задача этого слоя и заключается в том, чтобы несепарабельную (линейно не разделимую) проблему трансформировать в сепарабельную. Входные импульсы, проходя через связи первого слоя, отображаются на пространство А-элементов. Вот эта случайная матрица и обеспечивает трансформацию в сепарабельную проблему.

Большое число нейронов второго слоя и случайный характер их настроек гарантируют, что среди этих нейронов найдутся те, которые решают задачу разделения правильно. Второй же слой, как в перцептроне Розенблатта, так и в MLP уже только разделяет полученную после трансформации линейную задачу.

Наиболее важным результатом работы Розенблатта является доказательство того, что простая процедура обучения сходится к решению поставленной задачи. В Корнельской авиационной лаборатории была разработана электротехническая модель персептрона MARK-1, которая содержала 8 выходных элементов. На этом персептроне была проведена серия экспериментов по распознаванию букв алфавита и геометрических образов.

В 1969 году интерес к нейронным сетям снизился в связи с публикацией Минского и Пайперта, указавших на важный класс задач, которые однослойный персептрон решать не может. При этом задача обучения многослойного персептрона в то время еще не была решена: В 1982 году Джон Хопфилд показал, что высокосвязная сеть нейронов с обратными связями может быть описана как динамическая система, обладающая "энергией". При ассоциативном вызове сеть, стартующая в случайном состоянии, сходится к конечному устойчивому состоянию с минимальной энергией. Новый подход к описанию сетей с обратными связями оказался очень плодотворным.

< ДАЛЕЕ>