Обучение ИНС

<РАНЕЕ> <HOME>

6.4.1. Иные алгоритмы обучения сетей Хэбба

Последующее использование метода Хэбба для обучения нейронных сетей привело к большим успехам, но наряду с этим показало ограниченность метода; некоторые образы просто не могут использоваться для обучения этим методом. В результате появилось большое количество расширений и нововведений, большинство из которых в значительной степени основано на работе Хэбба.

Метод сигнального обучения Хэбба

Как мы видели, выход NET простого искусственного нейрона является взвешенной суммой его входов. Это может быть выражено следующим образом:

6-9

6-9

Где NETj — выход NET нейрона j, OUTi — выход нейрона I, wij — вес связи нейрона i с нейроном j.

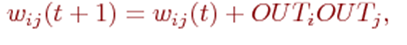

Можно показать, что в этом случае линейная многослойная сеть не является более мощной, чем однослойная сеть; рассматриваемые возможности сети могут быть улучшены только введением нелинейности в передаточную функцию нейрона. Говорят, что сеть, использующая сигмоидальную функцию активации и метод обучения Хэбба, обучается по сигнальному методу Хэбба. В этом случае уравнение Хэбба модифицируется следующим образом:

6-10

6-10

6-11

6-11

Где wij(t)— сила синапса от нейрона i к нейрону j в момент времени t, OUTj — выходной уровень пресинаптического нейрона равный F(NETi), OUTi— выходной уровень постсинаптического нейрона, равный F(NET).

Метод дифференциального обучения Хэбба

Метод сигнального обучения Хэбба предполагает вычисление свертки предыдущих изменений выходов для определения изменения весов. Данный же метод, называемый методом дифференциального обучения Хэбба, использует следующее равенство:

wij(I`+1) = wij(t)+[OUTi(t)-OUTi(t-1)] [OUTj(t)-OUTj(t-1)], 6-12

где wij(t) — сила синапса от нейрона i к нейрону j в момент времени t, OUTi(t) — выходной уровень пресинаптического нейрона в момент времени t, OUTj(t) — выходной уровень постсинаптического нейрона в момент времени t.

<ДАЛЕЕ>